Tối ưu hóa quy trình tạo hình ảnh trên Google Cloud

Các mô hình khuếch tán GenAI như Stable Diffusion và Flux mang đến khả năng tạo hình ảnh ấn tượng nhưng đòi hỏi tài nguyên tính toán lớn, làm tăng chi phí và thời gian xử lý. Thách thức đặt ra là làm thế nào để tối ưu hóa quy trình mà vẫn đảm bảo chất lượng hình ảnh. Trước khi thu nhỏ mô hình để tiết kiệm chi phí, cần tối ưu hạ tầng và phần mềm để đạt hiệu suất cao nhất. Dưới đây là cách Google Cloud giải quyết vấn đề này. Hãy cùng Cloud Ace tìm hiểu ba chiến lược giúp nâng cao hiệu quả, giảm chi phí và cải thiện trải nghiệm người dùng nhé.

Cách Google Cloud tối ưu hóa toàn diện

Để nâng cao hiệu suất và giảm chi phí, doanh nghiệp cần một chiến lược tối ưu hóa toàn diện, từ phần cứng, mã nguồn đến kiến trúc tổng thể. Chính vì vậy, Google Cloud đã áp dụng AI Hypercomputer – kiến trúc siêu máy tính linh hoạt kết hợp TPU, GPU cùng các nền tảng như PyTorch. Dưới đây là những yếu tố quan trọng:

1. Tối ưu hóa phần cứng

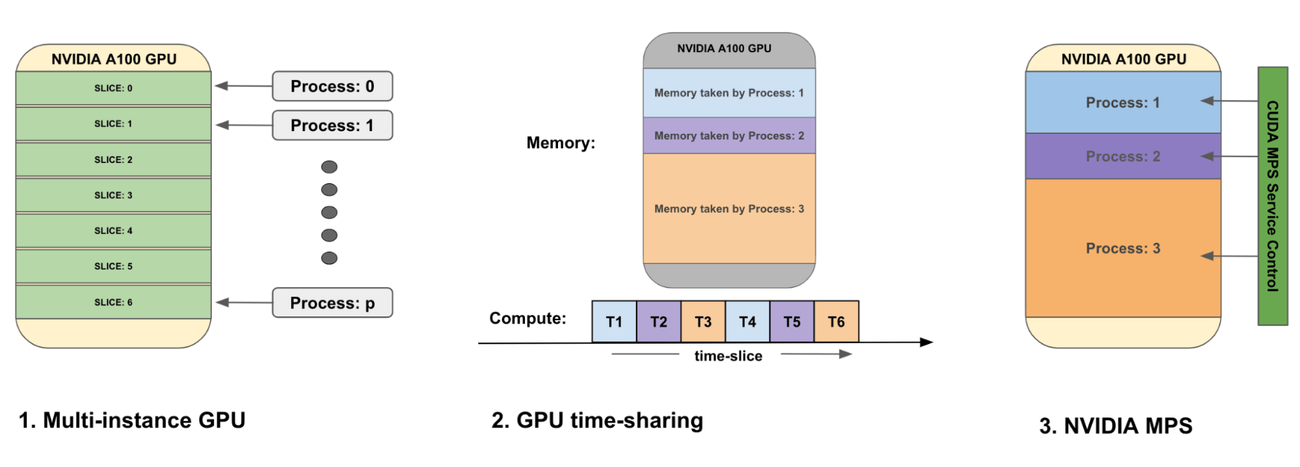

GPU và TPU đóng vai trò quan trọng trong quy trình tạo ảnh, nhưng nếu không được sử dụng hợp lý, chúng có thể làm tăng chi phí vận hành. Do GPU không thể phân bổ theo đơn vị nhỏ, tình trạng lãng phí tài nguyên khi mở rộng quy mô là phổ biến. Google Kubernetes Engine (GKE) cung cấp nhiều giải pháp chia sẻ GPU để tối ưu hóa hiệu suất. Ngoài ra, A3 High VMs với NVIDIA H100 80GB GPU có kích thước nhỏ hơn, giúp mở rộng linh hoạt và kiểm soát chi phí tốt hơn. Dưới đây là các chiến lược chia sẻ GPU trong GKE:

🔹 Multi-instance GPUs: GKE chia một GPU thành tối đa 7 phần riêng biệt, mỗi phần có tài nguyên độc lập (xử lý, bộ nhớ, băng thông) và được gán cho một container. Chiến lược này phù hợp với các tác vụ suy luận yêu cầu hiệu suất ổn định và khả năng phục hồi. Hiện tại, NVIDIA A100 (40GB, 80GB) và H100 (80GB) là các GPU được hỗ trợ.

🔹 GPU time-sharing: Cho phép nhiều container sử dụng toàn bộ GPU thông qua chuyển đổi ngữ cảnh nhanh, giúp tối ưu tài nguyên cho các tác vụ ngắn hạn hoặc thử nghiệm. Phương pháp này giảm thời gian GPU không hoạt động nhưng có thể gây độ trễ nhỏ do quá trình chuyển đổi ngữ cảnh.

🔹 NVIDIA Multi-Process Service (MPS): Phiên bản CUDA API này cho phép nhiều container chạy đồng thời trên cùng một GPU mà không bị xung đột, phù hợp cho các tác vụ xử lý theo nhóm quy mô nhỏ đến trung bình. Tuy nhiên, cần đảm bảo rằng khối lượng công việc có thể chịu được các hạn chế về bảo vệ bộ nhớ và xử lý lỗi.

2. Tối ưu hóa mã suy luận

Để tăng tốc pipeline PyTorch, người dùng có thể áp dụng một số kỹ thuật tối ưu hóa sau:

- 🔹 PyTorch's compile method: cho phép biên dịch code PyTorch theo thời gian thực (JIT), tạo ra các hạt nhân tối ưu để tăng tốc thực thi, đặc biệt trong bước decoder. Các backend như NVIDIA TensorRT, OpenVINO hoặc IPEX có thể được sử dụng tùy vào phần cứng. Framework khác như JAX cũng hỗ trợ tính năng JIT compilation tương tự.

- 🔹 Flash Attention: Khi bật các thuộc tính torch.backends.cuda.enable_flash_sdp, PyTorch sẽ tự động sử dụng Flash Attention để tăng tốc tính toán khi phù hợp, hoặc chọn cơ chế khác nếu Flash không tối ưu với đầu vào.

- 🔹 Hạn chế truyền dữ liệu giữa GPU và CPU: Việc tải tensor hoặc so sánh tensor với giá trị float có thể gây độ trễ do di chuyển dữ liệu. Để tối ưu, tensor chỉ nên được tải lên GPU một lần trong suốt pipeline, đặc biệt quan trọng với pipeline tạo ảnh có nhiều mô hình liên kết. Công cụ PyTorch Profiler giúp theo dõi thời gian và mức sử dụng bộ nhớ, hỗ trợ tinh chỉnh hiệu suất.

3. Tối ưu hóa pipeline suy luận

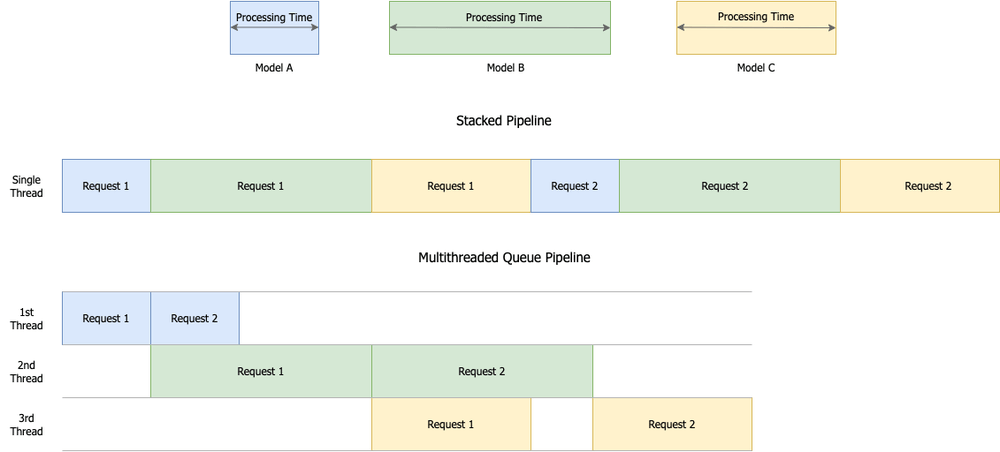

Tối ưu hóa mã giúp tăng tốc từng mô-đun trong pipeline, nhưng để đạt hiệu suất cao nhất, cần xem xét toàn bộ quy trình. Nhiều pipeline tạo ảnh đa bước sử dụng nhiều mô hình nối tiếp nhau (như sampler, decoder, mô hình nhúng ảnh/văn bản) trên cùng một container với một GPU duy nhất.

Trong pipeline dựa trên Diffusion, các mô hình như decoder có độ phức tạp tính toán cao hơn đáng kể so với mô hình nhúng, dẫn đến thời gian xử lý lâu hơn và có thể gây tắc nghẽn. Để tối ưu hóa GPU và giảm bottleneck, bạn có thể áp dụng phương pháp xếp hàng đa luồng (multi-threaded queue) để lập lịch và thực thi tác vụ hiệu quả hơn. Cách này cho phép các giai đoạn pipeline chạy song song trên cùng một GPU, giúp xử lý nhiều yêu cầu đồng thời, giảm thời gian GPU chờ và tối đa hóa tài nguyên.

Ngoài ra, việc duy trì tensor trên cùng một GPU trong suốt quá trình xử lý sẽ giảm bớt chi phí chuyển dữ liệu giữa CPU và GPU, từ đó tăng hiệu suất và tối ưu chi phí vận hành.

Cloud Ace - Managed Service Partner của Google Cloud

- Trụ sở: Tòa Nhà H3, Lầu 1, 384 Hoàng Diệu, Phường 6, Quận 4, TP. HCM.

- Văn phòng đại diện: Tầng 2, 25t2 Hoàng Đạo Thúy, Phường Trung Hoà, Quận Cầu Giấy, Thành phố Hà Nội.

- Email: sales.vn@cloud-ace.com

- Hotline: 028 6686 3323

- Website: https://vn.cloud-ace.com/